wly2020-robot

wly2020-robot

# v# 2519 f# 5022 vt# 3263 vn# 2519 texture file ../obj/diablo3_pose/diablo3_pose_diffuse.tga loading 1024x1024/24 ok texture file ../obj/diablo3_pose/diablo3_pose_nm_tangent.tga loading 1024x1024/24 ok texture file ../obj/diablo3_pose/diablo3_pose_spec.tga loading 1024x1024/24 ok # v# 4...

点位跟踪,求教大神指导!上效果图: 1 原模板图上任意取一点  2 不同旋转角度和平移后,跟踪后的对应点位(被放大)效果图:   134dec2dbde3.jpg)

你好,meiqua.我用的是你开源的实例shape_based_matching_fusion_by_hand。由于考虑到匹配角度精度问题,我将angle_test(“train”)函数中的一行代码由shapes.angle_step=1改了shapes.angle_step=0.1;训练和测试图片分辨率是:2048*2448; 运行angle_test("test");运行时间由0.087616s提升到0.16139s;请问这是正常的吗?运行速度能优化吗?运行环境:VS2017+OPENCV3.4.9+WIN10.

你好,meiqua!我在测试匹配检测程序运行时间时,发现读取test_templ.yaml和装载test_info.yaml这两个训练数据文件耗时太多,大概在60ms左右,如果训练加上scale,耗时会去到240-300ms,而后面匹配检测和精确度处理也就差不多也就60ms左右。请问读取和装载着两个训练文件需要这么长时间正常吗?可以优化吗?谢谢。

模板制作对匹配影响

你好,我采用mask掩码制作任意形状模板,我试了,也可以匹配,但是我对掩码部分会不会影响匹配效果不太确定,请问掩码部分会影响匹配效果(也就是会不会影响匹配的得分)吗?谢谢!附件原图和 模板图效果: 模板图:  原图:

你好,我在针对某一个检测目标,训练模板的时候,设置classId一样,进行多次训练,得到的model_templ.yaml里面数据一直在递增;尽管我在训练模板前把之前的model_templ.yaml删除掉,情况没有得到改变;这样会导致后面检测访问越界时出错;出错代码如下: float r_scaledW = templWidth / 2.0f*m_infos[match.template_id].scale; float r_scaledH = templHeight / 2.0f*m_infos[match.template_id].scale; 我认为肯定是哪里保存上一次的训练数据,这样对于classId一样,每训练一次,在原先基础上保存一次,后面一直积累;对于classId一样,能否只保存当前训练的数据到model_templ.yaml里面?谢谢!这是训练3次的训练数据文件附件: [model0_templ.log](https://github.com/meiqua/shape_based_matching/files/6369316/model0_templ.log)

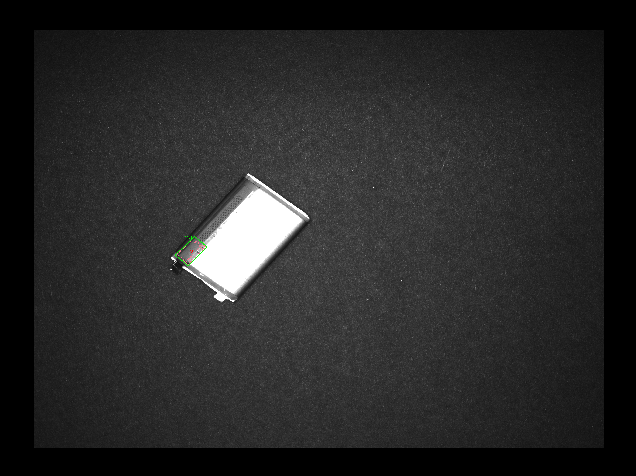

你好,关于尺寸变化匹配问题请教你。 训练图:  训练代码配置:  运行结果:   匹配位置区域变小及严重偏移。

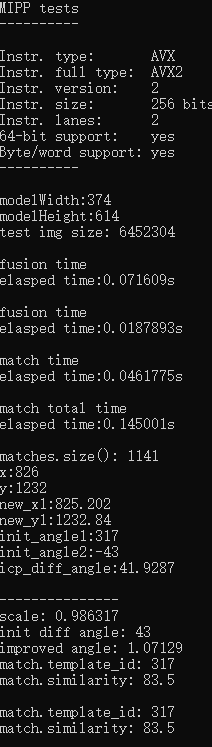

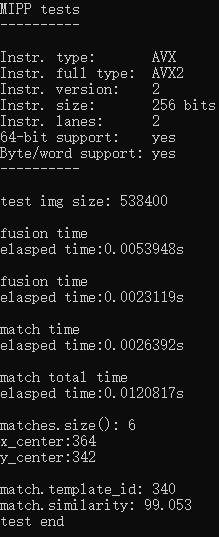

你好,meiqua!我运行实例shape_based_matching-fusion_by_hand中的angle_test,得到的结果如下:  得到的匹配中心点坐标:(364-100,342-100),即就是(264,242). 而模板中心坐标为(130 + 270/2,110+270/2),即就是(265,245). 中心坐标有1至3个像素偏差,请问正常吗?谢谢。

你好。我是fusion+icp融合版本;在电脑上运行,耗时:70ms左右;移植到瑞芯微RK339 上的arm+linux上运行400ms左右?检测图片已经resize 缩小2倍进行测试;请问算法方面能否加速?使得耗时控制在70ms左右?谢谢。

你好!我把模板图像和要检测图像分别缩小2倍,进行训练和检测,但是在运行这行代码:std::vector matches = detector.match(padded_img, ui->matchThreshSpinBox->value(), ids);会出现程序崩溃;如果不缩放,程序正常运行。