wuwenke

wuwenke

识别的流程如下: 1.把图片进行二值化, 2.粗略计算文字所在的区域位置 3.判断图片是否有旋转角度,如果是,则透视变换矫正重复1,否则4 4.裁图 5.二值化,根据水平投影确定文字行 6.遍历文字行,根据垂直投影确定文字行的左右边界,精确裁剪 7.对步骤6裁剪的图片ocr识别 8.重复5 在以上步骤中,对最终识别影响比较大的有如下几点: 1.图片倾斜比较严重。 会导致4步骤裁图时,把文字区域误裁掉 2.图片的背景和身份证颜色区分度不高或背景色比较花哨,导致二值化效果不好 3.ocr 识别不准确 解决: 首先开启debug模式(ocr.py中 DEBUG=true),利用pycharm IDE进行断点调试, 直观查看裁图情况。 如果裁图不正确,可以调整参数比如:二值化算法顺序等等 如果正确裁图,那么就是识别字库的问题了,这个只能靠自己训练字库来解决

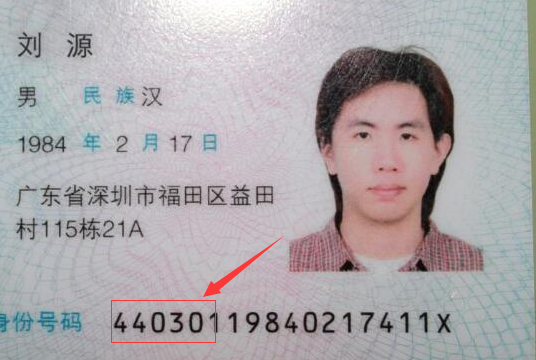

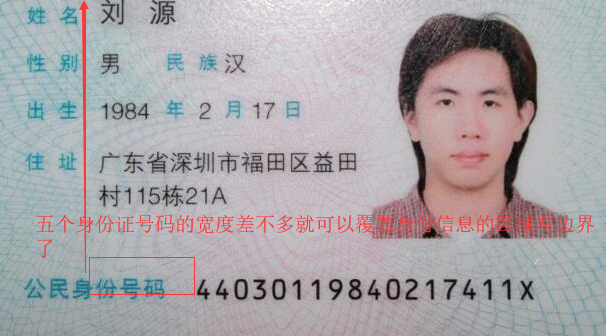

@yushusun 我的思路比较简单,就是身份证号码区域的左上顶点的x坐标,减去 五个半身份证号码的长度, 这样大致可以包括身份证其他信息的左边界。 位置是大致估算的,有些有仰角的、或者不在中央区的图片可能误差就会大些 看图示

the support for APIv3.