linklist2

linklist2

> > > 对prune_model_keep_size2和update_activation的理解 > > > block: conv1-bn1-leaky1-conv2-bn2-leaky2 > > > 在prune_model_keep_size2中,依据bn层γ来选择哪些层被剪,小于阈值的层要被剪掉。 但被减去层的bias(β)还是会影响到结果,因此我们对BN1.weight筛选后还需要将被剪通道的bias转移至后续层计算,这样减少bias的影响 为什么说是减少呢? 回顾BN层计算:w*x+b,这儿w即γ,bias即b w小于阈值的直接被置0,但在训练过程中w可能非常小,但也很微妙影响到输出。w趋向0,则对应层输出受bias控制。 > > > prune_model_keep_size2处理逻辑: > > > > > > 1. 将BN1中γ小于阈值的层权重置0 >...

@yjh0410 您好,很感谢您的耐心解答,您的猜测是正确的,新加的DilatedEncoder是随机初始化的并没有在COCO数据上训练过。 我还想再请教您,在1080Ti的机器上用COCO数据集训练这样的模型是可能实现的吗(指显存)?还有您能否分享一些调参的技巧呢?我是个在目标检测上的挣扎了好多个月的小白,换过很多结构,但大多是以掉点失败收尾,我想是不是可能会有超参的影响?

@yjh0410 再次感谢您的解答。确实有这种感受,尤其在yolov5的项目中,我前几个月的工作扑在了研究对yolov5的剪枝中,将各种剪枝算法嵌入到里面去后,总是很失望地发现mAP变为了0或者一个很低的数值,而且很久也微调不上去,和这些剪枝算法用在yolov3的中的表现差距特别明显。到了年底了,目标检测有点搞不动了。

@yjh0410 好的,非常感谢

@yjh0410 好的,谢谢。另外我还有个问题想请教您,YOLOF的源码中的最后classification、objectness、regression的卷积都是3×3大小,而您的实现代码中,这些都是1×1卷积,这会对结果造成影响吗?

@yjh0410 我也是因为在win10安装不好那个CVpods才寻找纯pytorch版本的代码的,另外有个问题想请教您,是否可以将这篇论文的Encoder和Decoder部分用于其他网络结构,例如YOLOV5,也会同样有很好的效果吗?

很感谢您的解答以及您的复现代码,我会尝试以上操作,等有了进展再来联系您。 ------------------ 原始邮件 ------------------ 发件人: "yjh0410/PyTorch_YOLOF" ***@***.***>; 发送时间: 2021年12月24日(星期五) 中午11:25 ***@***.***>; ***@***.******@***.***>; 主题: Re: [yjh0410/PyTorch_YOLOF] 请问如何训练自己的数据集? (Issue #1) @linklist2 可以考虑使用mmdetection复现的YOLOF:https://github.com/open-mmlab/mmdetection/tree/master/configs/yolof YOLOF的Encoder是可以用在其他结构上的,比如我新实现的YOLOv2(https://github.com/yjh0410/PyTorch_YOLO-Family),其实就用了他的DilatedEncoder,性能很不错。至于他的Decoder结构,其实就没啥可借鉴了,标注的解耦头结构,在RetinaNet里就有了。 将DIlatedEncoder加入YOLOv5中能否有效果,可以参考我的YOLOv3(https://github.com/yjh0410/PyTorch_YOLO-Family),38的AP,要比YOLOv3-SPP还高,所以,我觉得会有效果,但效果能否显著就不一定了。 另外,它的uniform matching也可以在YOLOv5中试一试,说不定这种把每个目标的正样本数量均衡一下,也是个很好的训练方式,可能要比YOLOv5自己用的那种方式会好一些。 — Reply to this email directly, view it on GitHub,...

@yjh0410 您好,您实现的Pytorch-YOLO-Family支持训练自己的数据集吗?

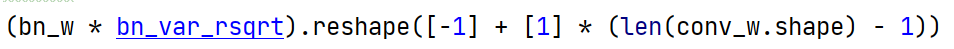

@ayoggchen  是为了将bn_w与bn_var_sqrt相乘后的结果reshape成 [-1,1,1,1] 的形状,也就是[输出通道数, 1, 1, 1] 方便下一步与conv_w相乘

> > I did not understand this code, can anyone help me understand this code?  > > Have you ever make clear what does this equation mean? I can't...