Lebron-Harden

Lebron-Harden

最近在做古籍识别,用到了paddleocr中的attention部分作为序列预测部分,但是碰到了一个问题: 在attention的decoder部分,如果将前一时刻decoder的输出作为当前时刻的输入,模型训练效果很差,收敛很慢,准确率上不去;但是如果将前一时刻的真实标签作为当前时刻的输入,模型收敛速度直接起飞,很快训练准确率就到1,但是预测准确率一直是0,似乎是这样做直接把真实标签作为了训练模型的输入,导致模型根本没有得到训练。 但就我个人对seq2seq模型的理解,在训练时将前一时刻的真实标签作为当前时刻的输入,应该是更容易将模型往理想的方向训练,更容易收敛,模型理应训练得更好,但是出现了预测准确了一直为0的情况。我真的很困惑,不知道大佬是否可以解决一下我的疑问。

rt,想用ser和re的推理模型进行关键信息提取,但是参数里面有一个ser_dict_path不知道是什么,没有找到这个东西,也没有哪里有说明,求大佬解惑。

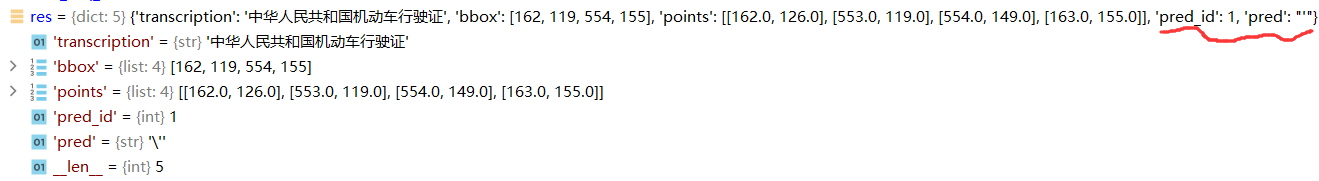

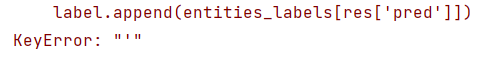

rt,不太明白这里的pred和pred_id分别是什么意思,然后这里的pred是“'”,结果就在下面报了keyerror、  跑的是ser+re模型,单独跑ser模型是没有问题的,但是我参数设置都是按照文档里面来的,不知道为什么会报这样的错误。

如题,我的--arch参数是设置的armv8,然后--with_python=ON,结果编译出来的python的wheel文件是x86_64的,求问这是哪里出问题了?

Currently I'm doing research on car window dection and I have tried this project. Results are not good. So i'm wondering using my own car window images to finetune the...

如题,最近在做车牌识别任务,这种双层的车牌我试过了paddleOCR给的推理模型,发现并不能正确识别,不知识别算法能够处理这种双行文字识别吗?在训练数据中加入这种是否可以识别呢?

如题,这里构造函数应该声明为explicit的

### 请提出你的问题 问题如图,使用命令python3 tools/eval.py -c configs/kie/layoutlm_series/re_layoutxlm_xfund_zh.yml -o Architecture.Backbone.checkpoints=./pretrained/re_vi_layoutxlm_xfund_pretrained/best_accuracy执行验证阶段,报了错,打印出来这个entities的维度是4,这里unpack只有三个参数,不知道是什么原因, paddlenlp 3.0.0b4 paddlepaddle-gpu 3.2.0 paddlex 3.3.8

### 请提出你的问题 问题如图,在自动下载transformers/layoutxlm_base/model_state.pdparams权重时,失败,后面训练无法推进,求解决