jinsheng.chen

jinsheng.chen

> Could you point to which prune methods you are using? Or which files you are referring to? imagenet/l1-norm-pruning/prune.py line 131

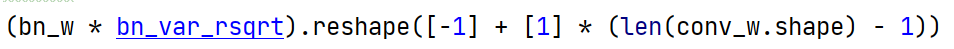

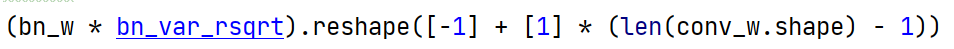

请问在conv_w部分,为什么要在最后要加上[1] * (len(conv_w.shape) - 1)

> @ayoggchen  是为了将bn_w与bn_var_sqrt相乘后的结果reshape成 [-1,1,1,1] 的形状,也就是[输出通道数, 1, 1, 1] 方便下一步与conv_w相乘 明白,另外想确认一下,如果任务不需要bn层,是不是不需要做fuse的操作,直接将卷积赋值成diract和原值组合就可以了?

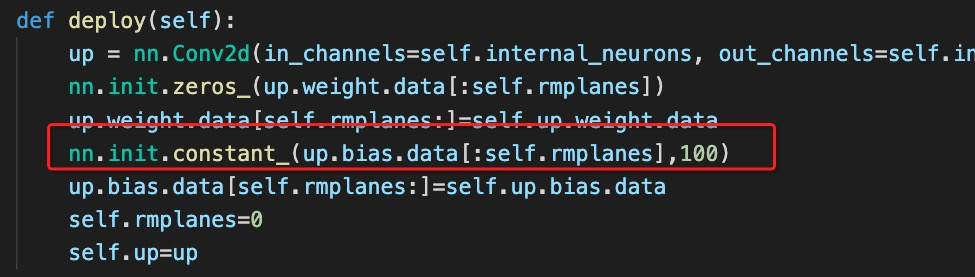

还想问一下,为什么在rmrepse.py中,对up.bias的初始化需要添加一个100的常量呢? > @ayoggchen  是为了将bn_w与bn_var_sqrt相乘后的结果reshape成 [-1,1,1,1] 的形状,也就是[输出通道数, 1, 1, 1] 方便下一步与conv_w相乘