KoBERTScore

KoBERTScore copied to clipboard

BERT model 별 best layer 를 선정하기 위한 Korean STS 데이터 확보

배경

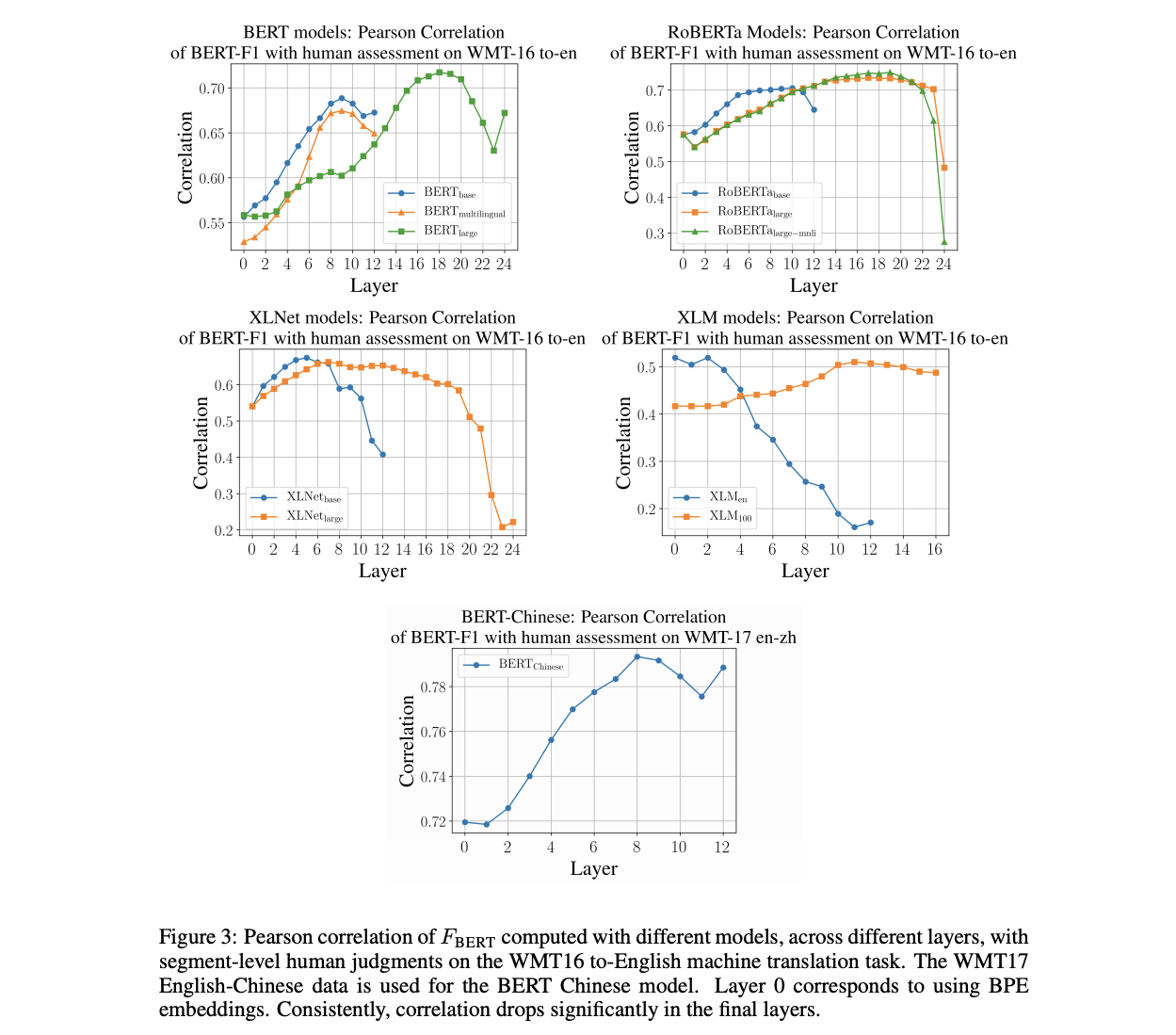

- 언어 별로 성능이 가장 좋다고 알려진 BERT 계열 모델이 있으며, 각 모델 별로 best performance 를 보이는 layer 가 다름

- 이는 아래처럼 evaluation data 와 BERTScore 와의 correlation 을 바탕으로 결정

문제

- 그러나 한국어에 대해서는 유의미한 STS 데이터를 대량으로 확보하기 어렵다.

- Kakaobrain 의 KorSTS 는 STS 데이터를 번역기를 통하여 번역한 데이터이며

- 학습데이터의 양이 약 6천으로 매우 작다. 참고

- STS 데이터를 만들기 위한 annotation guideline 이 있다.

- Semeval2016 에서 annotation 가이드 가 제공되고 있다.

- SemEval tasks 에 대한 개요는 다음의 링크를 참고

- https://en.wikipedia.org/wiki/SemEval

- STS 데이터를 만들기 위하여 (완전한 문장, 의미가 대체로 비슷하지만 불완전한 문장) 을 확보해야 한다.

-

ko-BLEURT에서 back-translation 을 이용한 STS 평가용 데이터를 만드는 이슈가 언급되었다. - 몇 개의 도메인에 대해서 back-translation 을 이용하여 평가를 맡길 데이터를 만들자. 아래 표를 수정하며 손쉽게 확보할 수 있는 도메인들을 리스트업하자

| 도메인 | 확보 방법 |

|---|---|

| 뉴스 기사 | 확보된 뉴스 기사에서 샘플링 |

| 뉴스 댓글 | Korpora hate speech 에서 샘플링 |

| 아이돌 커뮤니티 문서 | 확보된 커뮤니티 문서에서 샘플링 |

| 청와대 청원 데이터 | Korpora 의 korean_petitions 에서 각 섹션별로 샘플링 |

| 쇼핑 관련 블로그성 글 (뽐뿌) | https://github.com/lovit/ppomppu_scraper |