euler

euler copied to clipboard

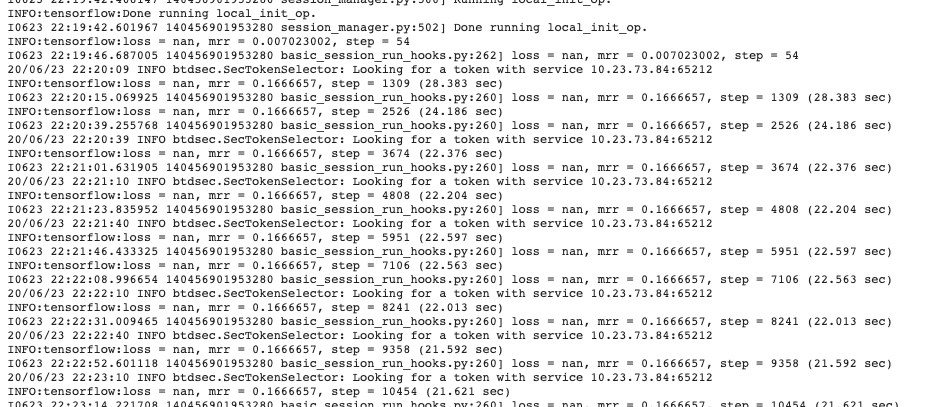

graphsage训练时loss为nan

你好 分布式训练graphsage时 loss一直为nan,mrr不变,相同的数据训练line没问题,参数如下,调小lr到0.001也一样,请问是什么原因呢? -aggregator='mean' -batch_size=512 -dim=64 -feature_dim=3 -feature_idx=0 -learning_rate=0.01 -max_id=60000000 -mode='train' -model='graphsage' -num_epochs=1 -optimizer='sgd' -share_negs=False -unsupervised_loss='rank'

-share_negs=False -unsupervised_loss='rank' 这个应该不是我们的参数,是不是实现‘rank’ loss 有问题?