使用Evaluation Toolkit评价腾讯词向量内存不够

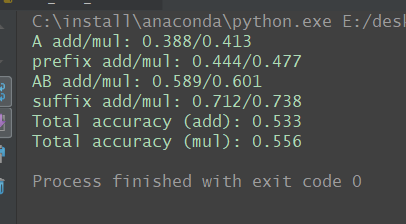

你好,我自己训练了一份词向量,利用Evaluation Toolkit工具中的ana_eval_dense.py文件评价得到如下结果:

这结果好像比你们提供的几份词向量结果都要好(对比了知乎问答、搜狗新闻词向量)。

然后我现在想用这个工具来检测腾讯词向量效果,无奈文件太大(15.5G),我62.8G内存的机器都不够用,请问ana_eval_dense.py代码中哪里可以优化解决吗?

这结果好像比你们提供的几份词向量结果都要好(对比了知乎问答、搜狗新闻词向量)。

然后我现在想用这个工具来检测腾讯词向量效果,无奈文件太大(15.5G),我62.8G内存的机器都不够用,请问ana_eval_dense.py代码中哪里可以优化解决吗?

https://github.com/Embedding/Chinese-Word-Vectors/blob/46a7b7d86255b35530beb12f765ecd0b23a86c40/evaluation/ana_eval_dense.py#L26 这里的topn设置一下,可以不读取后面的那些低频词,能节省很大的内存。

谢谢哟!

另外追问一下,确定腾讯词向量文件是按照词频高低来写入的?

我印象中它是按词频高低来写入的。另外可否贴一下semantic的测试结果?

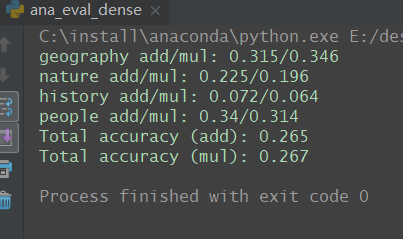

semantic的测试结果没有那么好

看来是语料有一些特点,请问大致是什么语料呢?

那可能是小说语料比较偏向口语的原因。

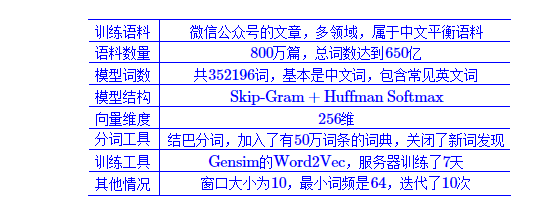

我是用下面这个已经训练好的模型:

https://kexue.fm/archives/4304

再追加数据(涉政10万文本、涉黄10万文本、正常100万文本)训练得到的

https://kexue.fm/archives/4304

再追加数据(涉政10万文本、涉黄10万文本、正常100万文本)训练得到的

刚才那个发错了,哈哈哈

公众号口语也很多,我们在项目首页的论文里面指出了口语语料对morphology的影响很大。

嗯嗯,如果根据morphological指标我训练的词向量应该可以了,因为我们的业务场景数据也偏向口语化

我花了一点时间,支持分块计算了 https://github.com/psy2013GitHub/Chinese-Word-Vectors